OmniHuman-1是字节跳动自主研发的多模态视频生成AI模型。它可以从单张图像和音频轨道生成高度逼真且同步的动画视频。以下是其核心功能和应用场景的详细解释:

多模态输入与生成:

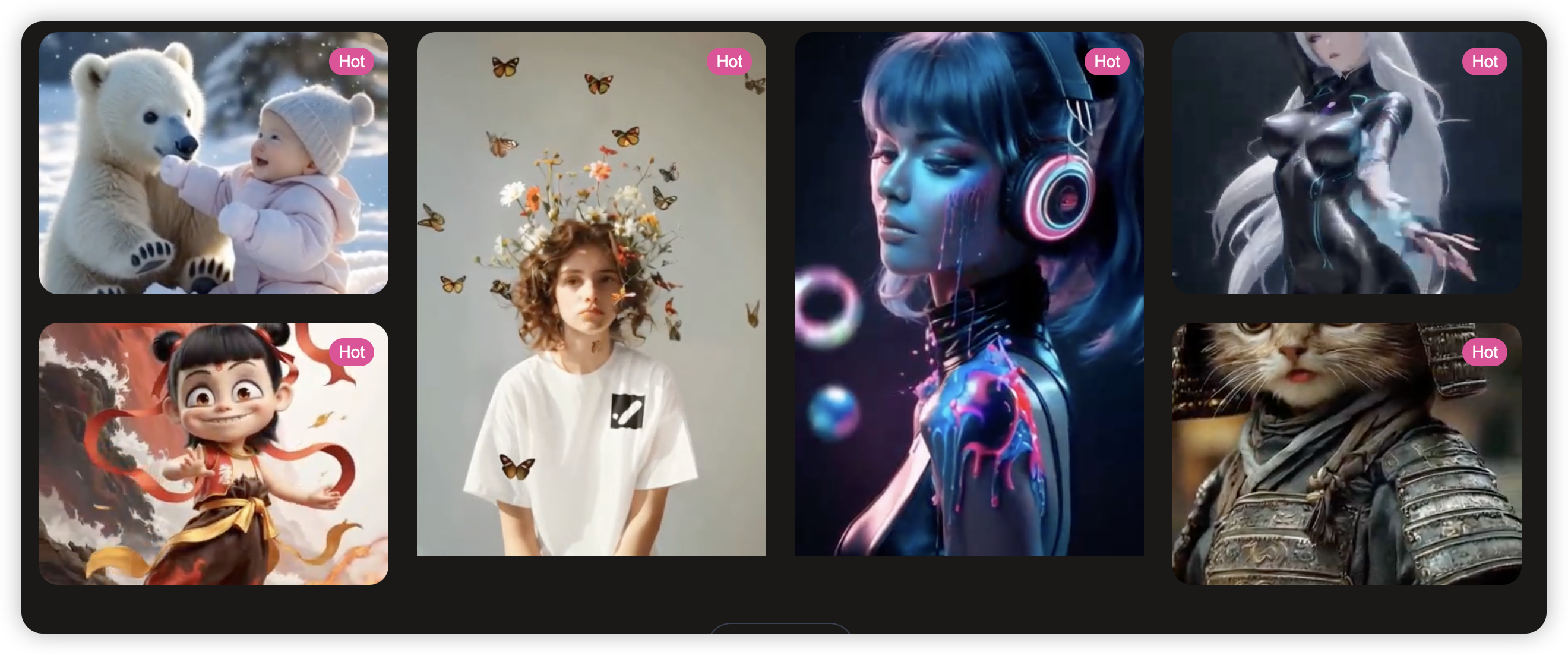

- 支持单张图像(包括真人、动漫、3D卡通等)和音频(如语音或音乐)的组合,生成包含面部表情、手势和全身动作的视频动画。例如,输入爱因斯坦的照片和一段演讲音频,可以生成他讲课的视频。

- 高精度同步:该模型在语音与唇部动作以及身体动作之间实现了极高的匹配精度,甚至支持侧视图的唇部同步,这在同类工具中尚属首次。

- 多样风格支持:除了真人外,它还可以生成动漫角色、动物形象等的动态视频,同时保持原有的风格和运动模式。

- 大规模数据训练:该模型在大约19,000小时的人类运动数据上进行了训练,可以生成长度不限的视频,并适应不同的输入信号。

- 应用场景

- 电影与广告制作:快速生成广告片段和虚拟角色表演,如美妆产品演示和音乐MV,显著降低传统拍摄成本。

- 教育与娱乐:创建历史人物演讲和虚拟偶像表演等内容,例如演示视频中的“会说话的阿尔伯特·爱因斯坦”。

- 动画创作:自动生成动漫角色的表情和动作,简化动画制作流程。

- 技术优势与局限性

- 优势:与传统的深度伪造技术相比,OmniHuman-1可以生成全身动画,具有更高的真实感和准确性。例如,生成的视频在手势和物体交互等细节方面表现出色。

- 局限性:目前,该模型尚未公开发布下载,仅在字节跳动内部进行有限的测试。生成电影级视频仍需优化。

- 安全与伦理措施 字节跳动已实施严格的安全审查机制,以防止技术被滥用。所有输出视频都带有水印,以识别AI生成的内容。

- 行业影响 OmniHuman-1被视为AI生成视频技术的重要突破,可能颠覆广告和电影制作等行业。例如,未来电影中的群众演员或动画制作可能会被AI取代,显著降低劳动力成本。此外,其轻量级版本Goku模型(拥有80亿参数)已经瞄准广告市场,展示了该技术应用的多样性。